审时度势,未雨绸缪

在上一周的专栏中,我们深入剖析了今秋发布的两份重磅研究,探讨了 AI 迄今为止对职场版图的冲击——以及未来更为深远的震荡。数据向我们揭示了一个残酷的现实:服务业专才与软件工程师可能正处于风暴中心,而蓝领阶层或将享有更强的屏障。然而,在这个被 AI 浪潮席卷的时代,迷雾笼罩着每一条职业赛道,谁也无法断言哪条路是绝对的"安全港",哪条路又是注定的"死胡同"。

我们解读斯坦福与耶鲁的研究,并非为了以神的视角裁决您该选择何种职业,而是为您提供思想的食粮。比起告诉您"去哪儿",我们更希望传授您一套无论身处何方都能致胜的心法,助您在 AI 时代确立最佳的生态位。

让我们潜入深处,一探究竟。

躬身入局,驾驭 AI 之力

要在 AI 时代立足,最根本的战略在于:您必须真正开始驾驭这些工具(若尚未开始),并大胆地试错与探索(若已略有涉猎)。

去博览众长,测试不同的大语言模型(我们在之前关于大学文书写作的测评中对比了 ChatGPT、Claude 和 Gemini,这或许是一个有趣的起点)。去探索不同的交互模式,体悟 LLM 的"推理能力"与单纯的"搜索能力"有何本质不同。您需要像我们之前测评 ChatGPT 作为学习工具时那样,深刻洞悉 AI "能为何"与"不能为何"的边界。

事实上,"懂得如何与 AI 共舞"本身就是一项核心技能。请看下面两个案例——当我要求 ChatGPT 帮我寻找芝加哥最好的五家汉堡店时,仅仅因为指令 (Prompt) 的微小差异,结果却天壤之别。

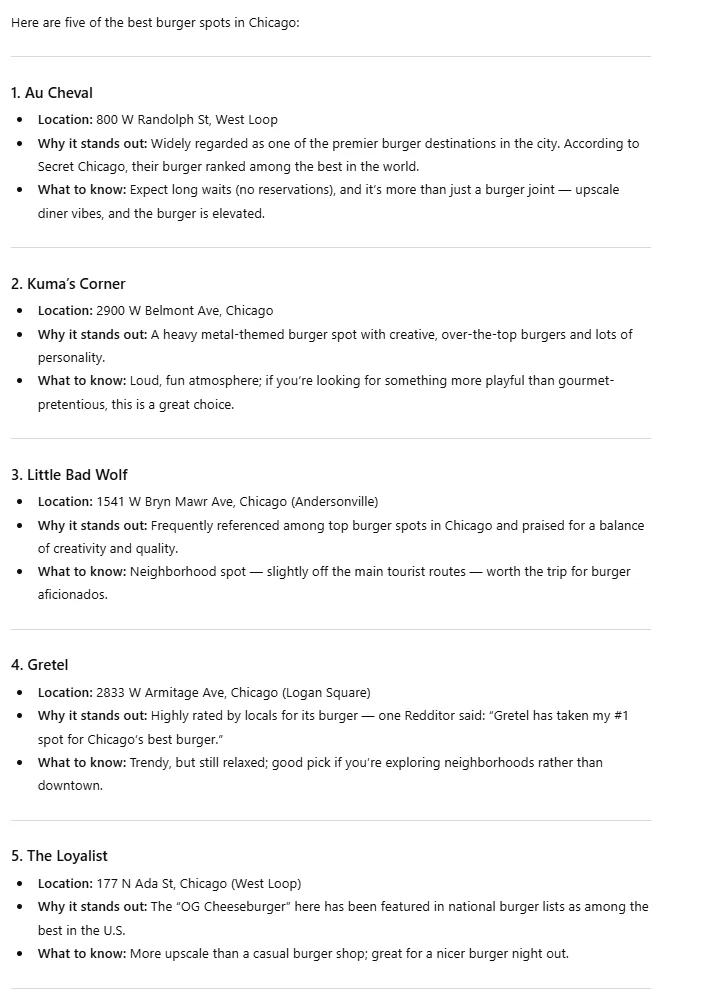

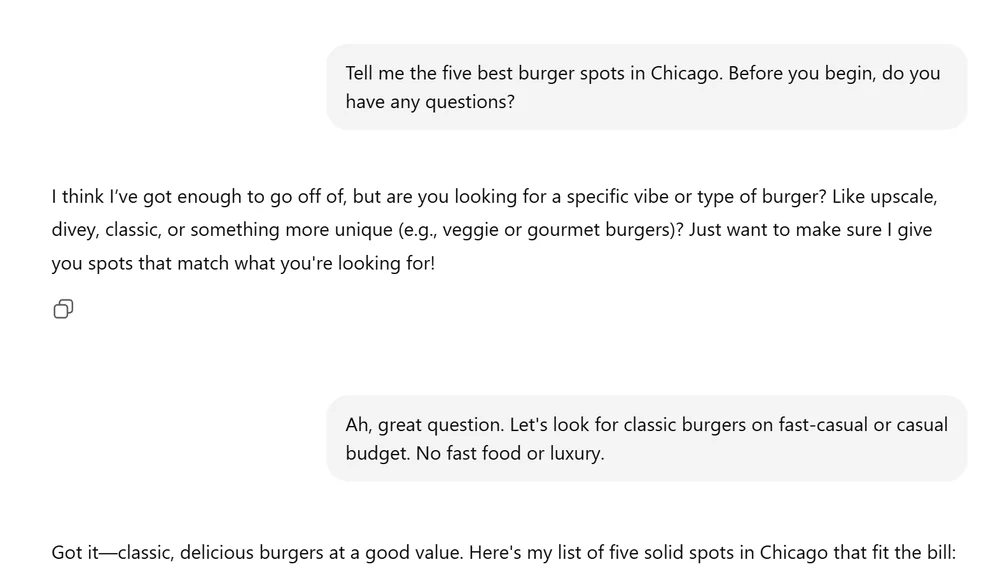

案例一:泛泛而谈的指令

案例二:寻求澄清的指令

您会发现,回应的质量有着云泥之别。我不仅得到了一份不同的名单,更重要的是,每一项推荐背后的逻辑都变了。当我明确指出我追求"高性价比的品质之选"时,ChatGPT 便将价格因素纳入了考量。这与第一个指令形成了鲜明对比——前者因为不知道我究竟想要什么,只能给出一个"万金油"式的回答。

第二个指令之所以高效,是因为我赋予了 ChatGPT "追问与澄清"的机会,而非让它草率交卷。这听起来简单,但许多人在与 AI 对话时,并未充分利用其"思维伙伴"的潜能。

抛开汉堡不谈,研究表明,那些将 LLM 视为思维伙伴的用户,其大脑激活程度远高于那些仅仅让 LLM 代劳的用户。这便是提示工程 (Prompt Engineering) 的艺术所在;花些时间去研习不同的指令模式,进行 A/B 测试以验证效果。无论是最基础的指令,还是多轮对话的链式指令,亦或是复杂的超级指令 (Mega Prompt),虽然这是另一个宏大的话题,但您无需成为 AI 专家,也能在这些实验中通过"人机博弈"找到乐趣。

您甚至可以探索利用 LLM 完成全新的任务。例如,如果您想设计网站却毫无技术背景,不妨尝试用 Claude 进行 "Vibe Coding"——将您用人类语言描述的愿景,由 LLM 转化为实际的代码。也许我们会在未来深入探讨 Vibe Coding,但这正是您可以在菁源 (Grassroot Academy) 平台上习得的技能。

归根结底,大胆实验是您最大化利用 LLM、洞悉其能力与局限的第一步。在做出任何职业抉择之前,最明智的做法莫过于——先看清您手中的武器,以及您面对的对手。

铸就 AI 无法复刻的人文护城河

下一个至关重要的锦囊:即便 LLM 拥有某种形式的智能,它们终究不是人类。即便它们处理信息的能力日臻化境,它们依然无法复刻人类的所有特质。这一点,在那些非纯逻辑的技能领域表现得尤为淋漓尽致。

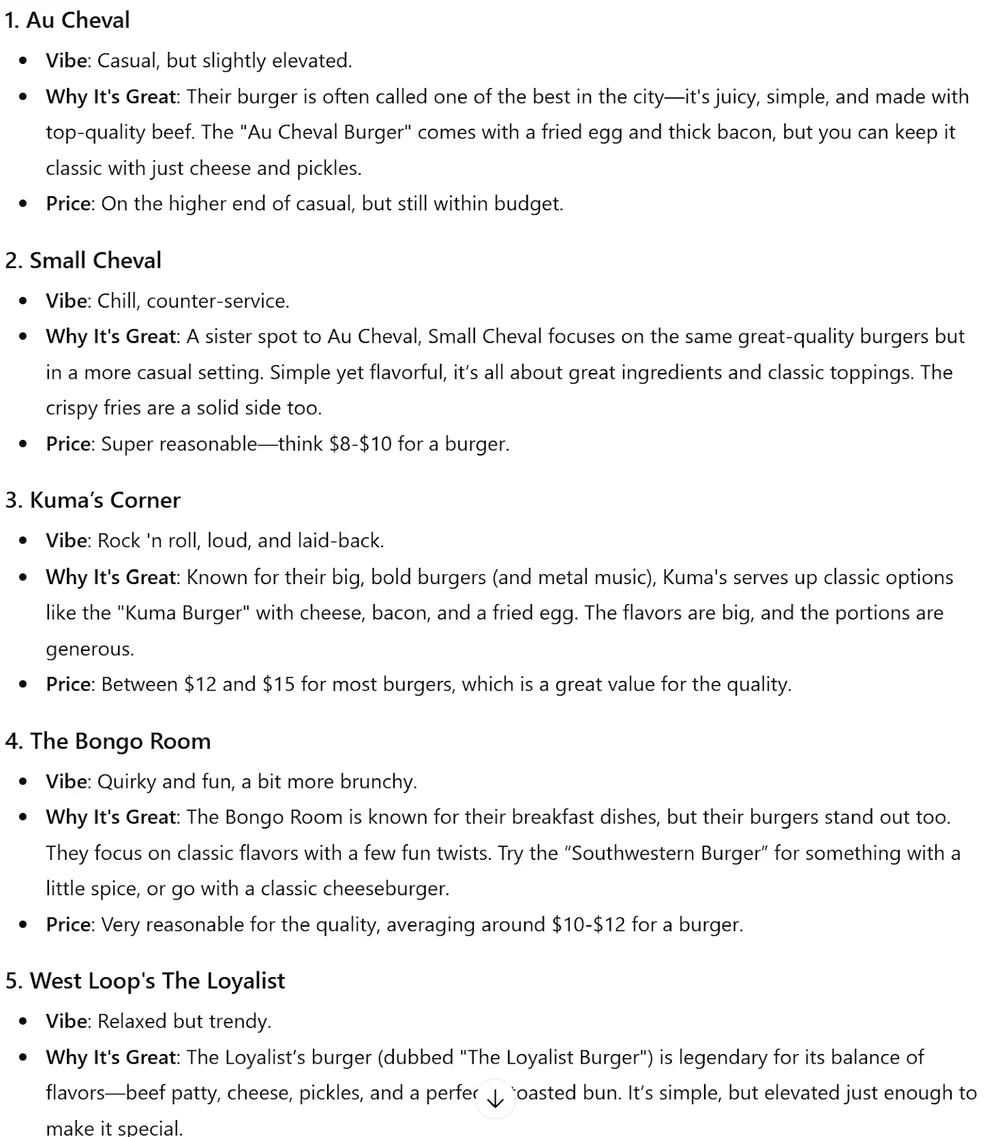

请看,当我请求 ChatGPT 协助进行一场假设的房屋买卖谈判时,它给出了什么建议。

很好——我们有了一些可执行的逻辑步骤。但这仅仅是逻辑层面的正确。如果说我在 AP 英语语言与写作课上学到了什么真理,那就是修辞学的三位一体:人格 (Ethos)、逻辑 (Logos) 与情感 (Pathos)。

仅有逻辑 (Logos) 是不够的。我要如何执行"释放诚意"的信号?我要如何施加"快速成交"的心理压力?ChatGPT 的建议在纸面上堪称完美,但将其付诸实践却是另一门艺术。

说服力、情商、同理心的传递——这些极具人性温度的特质,在许多职场中是不可或缺的灵魂。这正是为何像耶鲁研究指出的那样,教育行业的职业面对 AI 冲击具有更强的免疫力——试想一下,依靠 ChatGPT 去安抚一教室躁动的六年级学生,那是何等荒谬的场景。

并非每一份工作都像教师那样依赖人性的触碰,但这并不意味着您无法在当前的赛道上,磨砺那些独属于人类的软技能。

终身精进,以此身凌驾算法之上

最后,我们有一个听起来老生常谈,实则知易行难的建议。假设您用 LLM 辅助撰写历史论文,它吐出了一长串日期和陈述——您是照单全收,还是会像一位严谨的学者那样考证其真伪?

或者,想象您正与 ChatGPT 进行头脑风暴,探讨海明威《老人与海》中的圣地亚哥是否是一位英雄。您如何判断何时得到了一个满意的答案?换言之,您何时才有底气说:"这就够了,我得到了真理"?

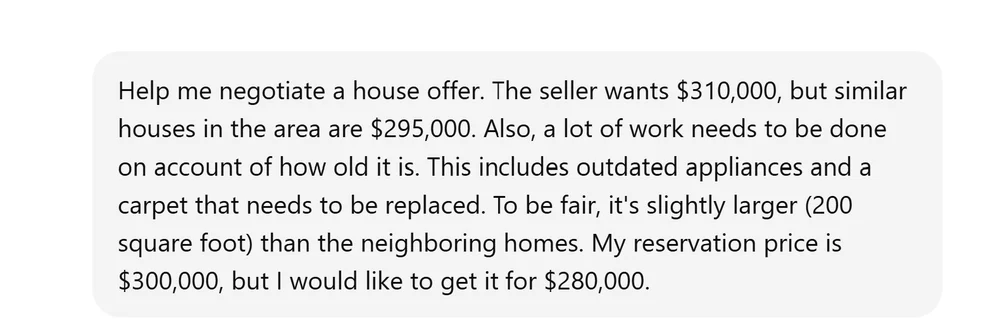

请看我与 ChatGPT 关于这个话题的博弈。

到目前为止,一切尚好。但作为一个曾以此为题撰写过论文的人,我敏锐地发现了一些关键的缺失。

- ChatGPT 提到了"失败胜于胜利"的观点,这本可用来佐证圣地亚哥的坚韧,尤其是考虑到他在故事结尾仍梦想着狮子,乐观精神未灭。

- 更重要的是,ChatGPT 完全遗漏了全书最核心的主题之一:傲慢 (Hubris)——正是他的骄傲导致了他的失败。

若非我反复研读原著(且没有被我的英语老师反复灌输关于"傲慢"的考点),我极有可能错过这本书的灵魂。正因为我懂得,我才能反驳 ChatGPT,迭代出更好的答案。若我无知,我将被 AI 的表象所蒙蔽,最终写出一篇平庸的文章。

那个免责声明——"ChatGPT 可能会犯错"——并非摆设。

请以体育竞技的视角来审视这一点。顶尖运动员都有教练。教练不需要比运动员体能更好,甚至不需要技术更精湛。但教练必须拥有足够的智慧与经验,在运动员犯错时予以纠正。

作为人类,您永远无法在文本处理的速度上战胜 LLM。您的思维与表达无法企及 ChatGPT 的产出效率。然而,作为决策者,您有责任知道 AI 何时犯了错,并懂得如何修正。

这就是为什么您必须持续在专业领域深耕,研习前沿趋势,用专业知识 (Expertise) 武装自己,从而始终凌驾于算法之上。

人类的经验,无可替代。

结语

在菁源 (Grassroot),我们无法预言未来职场的具体形态,但我们深知,您现在可以采取行动,在不确定性中确立最佳的生态位。无论是通过熟悉 AI 工具,磨砺人文软技能,还是保持求知的好奇心,您都将在剧变的职场版图中实现自我升维。

而在菁源,最美妙的是——您只需注册,便能毕其功于一役,同时实现这三大目标。

准备好执掌先机了吗?加入学搭子 (Grassroot Academy),学习如何高效驾驭 AI,同时铸就那些让您在任何职业中都无可估量、不可替代的人类核心技能。